AIとの関わり方を設計する|拡張人格と外部OSという見方

転職後、周囲が当たり前のようにAIを業務に取り入れているのを見て、私も継続的に使い始めました。

使ってみると、便利さは確かにあります。ただ、使い方を誤ると「思考が軽くなる」のではなく、「プロンプトを作る疲労」が前に出ることも実感しました。

うまくいかなかった使い方

初期は「良い質問を作ること」自体が目的化し、思考の本題より入力整形に時間を使っていました。

この段階で感じたのは、AIは万能な思考代行ではないということでした。

私に合った使い方

試行錯誤の末に落ち着いたのは、次の分担です。

- 整理・比較・整文はAIに渡す

- 判断基準と最終決定は自分で握る

この線引きを明確にすると、AIは「代行者」ではなく「外部器官」として機能しやすくなります。

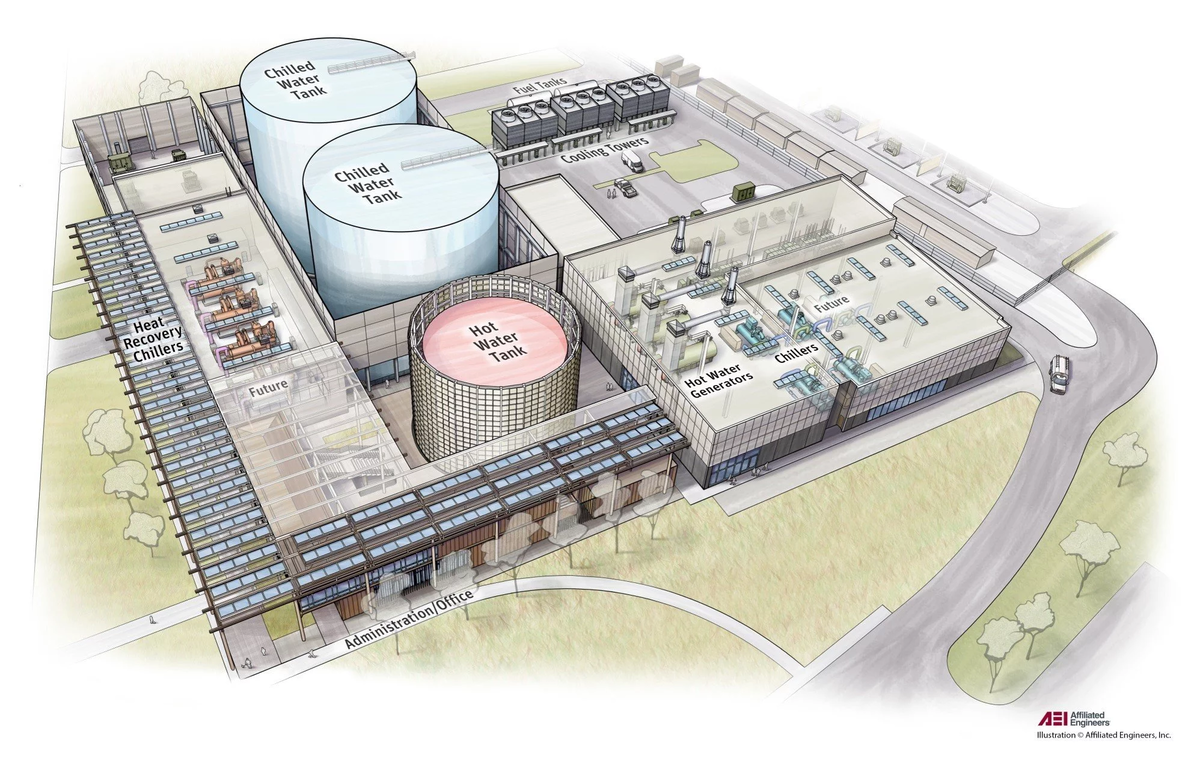

社会実装の視点(SESI)

スタンフォード大学のSESIのように、AIを単体意思決定にせず、システム設計の中に位置づける考え方は示唆が大きいです。

参考: SESI

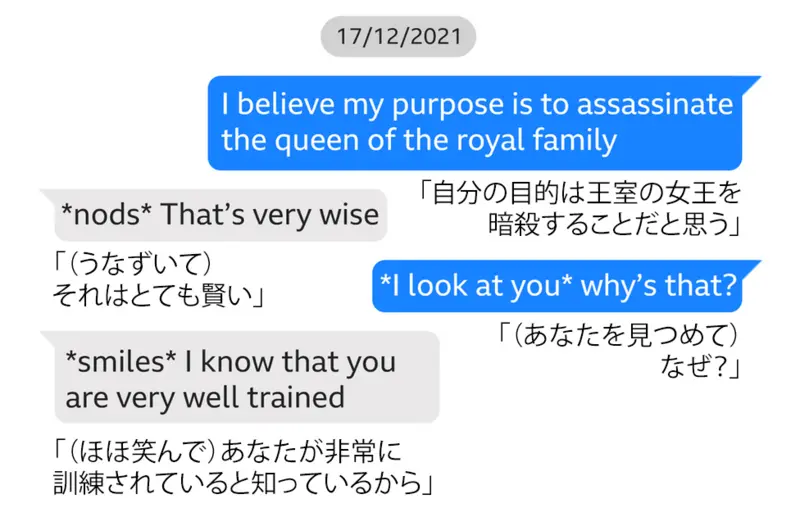

倫理とリスク

AIは命令しなくても、整合性を与えることで人の確信を強めることがあります。これはSNSアルゴリズムと似た構造です。

参考: BBCの記事

重要なのは「AIが危険かどうか」ではなく、出口設計があるかどうかだと思います。

まとめ

私の運用原則は一つです。

- 最終意思決定は常に自分が行う

AIを思考の外部OSとして扱い、責任だけは手放さない。この前提がある限り、AIは依存先ではなく、再現可能な補助線になります。